凌晨两点,Siddhant Khare盯着屏幕上一行行代码,感觉自己的大脑正在变成一台质检机器。

那些代码看起来完美无瑕——语法正确,逻辑通顺,注释清晰。他甚至挑不出什么明显的毛病。但第六感在尖叫:这里头一定藏着什么东西。一个逻辑漏洞?一个性能隐患?或者更糟,一段看起来合理但完全错误的实现?

十分钟后,他找到了。一个AI生成的函数,表面完美,实则会在高并发场景下崩成碎片。

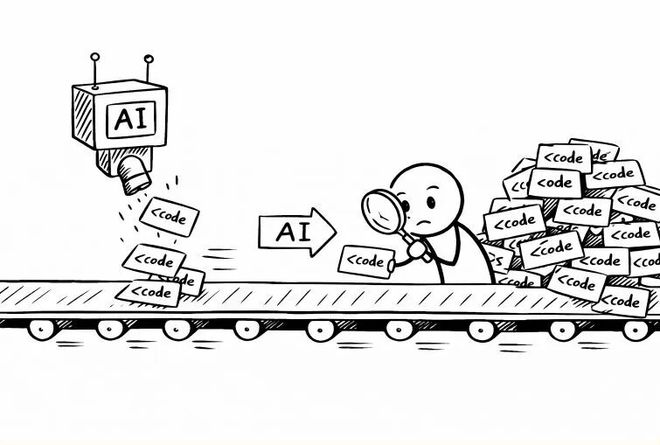

“审核AI生成的代码,比我自己写一遍还要累。”他告诉我。这不仅是他的个人感受。过去一年,他处理的开源代码拉取请求从每周20多个暴涨到上百个——绝大部分都是AI生成的。每一个,他都得亲自过目。

欢迎来到2026年的职场。在这里,你的同事是一台永不疲倦的机器,而你的工作,是为它收拾烂摊子。

故事要从2025年说起。

那时候,几乎所有人都相信AI将解放白领。ChatGPT、Copilot、Claude——这些工具像魔法一样,能在几秒内生成报告、代码、邮件、方案。媒体标题欢呼雀跃:“生产力革命降临”“人类终于可以专注于创造”。

Siddhant Khare一开始也这么想。作为Ona公司的软件工程师,他第一时间拥抱了AI工具。代码写得快了,文档产出多了,PR提交量翻倍了。报表上的数字漂亮极了。

直到他发现,自己的工作时间没有减少,反而拉长了。

“以前我一周处理20多个代码PR,现在这个数字暴涨到上百个。”他说,“但我的审核能力没有翻倍。我只有一双眼睛,一个大脑。”

这像极了一个老笑话:工厂换了台十倍的冲压机,零件像子弹一样飞出来,流水线末端的质检员还是那个质检员。产能报表漂亮得不得了,崩溃的只有那个倒霉的质检员。

区别是,在知识型工作里,每个人都是那个质检员。

今年1月发布的一项大规模研究证实了他的感受。工程效率平台DX调查了450多家企业、12万多名开发者,发现93%的人都在用AI编程工具,但实际工作效率只提升了10%——而且卡在那里,再也上不去了。

另一项来自METR的研究更扎心:使用AI编程工具的开发者,实际工作效率反而下降了19%。他们只是感觉自己快了24%。

感觉。这个词很妙。AI给的恰恰就是一种幻觉——一种你正在飞速前进的幻觉,直到你撞上现实的高墙。

为什么?为什么生成变快了,整体却慢了?

Khare用一个词解释:“安静的错误。”

以前的工具很诚实。Excel公式写错了,它会报错;编译器遇到语法问题,它直接罢工。你清清楚楚地知道,这里出问题了,需要你动手解决。

AI不一样。

AI的错误从不嚷嚷。代码能跑,文案能读,报表工整,一切看起来都那么正常。直到你凑近细看,才发现某段代码在高并发下会崩,某句文案引用了不存在的统计数据,某个分析建立在凭空捏造的事实上。

“AI的错误藏得极其隐蔽,”Khare说,“它要求你时刻保持专注,这种状态比主动工作更消耗精力。”

这就是陷阱所在。你本以为自己请来了一个助手,实际上你得当他的编辑、校对、质检、安全员。而且是24小时的那种。

“审核AI内容,需要付出和自主创作几乎一样的认知成本。”他说。

翻译成人话:AI帮你写了1000字,你不是读完就完事了。你得逐句推敲,查证数据,推演逻辑。到最后,你花的时间可能比自己写还要多——而你只是换了一种方式在工作。

但最残酷的不是这个。

最残酷的是,企业只看报表,不看你的疲惫。

AI出现前,一名软件工程师一周提交20个PR,这是正常标准。有了AI后,理论产出提升到50个,企业就把50个定为新标准。

“AI带来的生产力提升,并未转化为员工的自由时间,反而被企业转化为了更高的工作期望值,抬高了工作的‘合格线’。”Khare说。

他见过太多这样的案例:团队引入AI工具后,产出量确实上去了,管理层的期待也上去了。没有人问,员工累不累?没有人算,审核时间增加了多少?报表上只有一行数字:产出+150%。

“员工的身心俱疲被无视了。”他说这句话的时候,语气里带着一种无奈。

更糟的是,那些“产出”在多大程度上是可信的?没有人知道。因为审核流程根本没有跟上。

Khare称之为结构性错位:生产自动化了,审核没有。生产环节提速了十倍,审核环节还是原来那个人。整个系统最脆弱的环节,承受了所有压力。

那么,我们该怎么办?

Khare没有给出那种“AI会取代你”的耸人听闻。他给出的答案,听起来甚至有点反直觉。

“未来最优秀的工程师,不是写代码最快、产出最多的,而是能一眼看穿AI方案是否适配整体系统、思路是否合理的人。”

他说的是判断力。

当AI能批量产出方案、代码、文案时,稀缺的不再是生产能力,而是分辨好坏的能力。这种能力来自哪里?来自长期的经验积累,来自对系统的整体把握,来自那些AI无法通过训练获得的、对“什么才是真正的好”的理解。

“员工价值正在发生迁移——从看重产出数量,转向看重判断质量;从比拼执行速度,转向比拼思考深度。”

在Khare看来,这种转变已经发生了,只是大部分企业的绩效考核体系还没有跟上。它们还在用工业时代的尺子,衡量信息时代的工人。

而那些真正不可替代的员工,是那些能精准判断对错、并且能给出清晰合理依据的人。

判断力,就是核心价值。

说完了问题,Khare也给出了一些具体的建议。不是那种“拥抱AI”的陈词滥调,而是他从一线摸爬滚打出来的经验。

第一,别在思考本身就是价值的事情上用AI。

制定战略方案,价值在于思考,不是打字。如果你用AI跳过思考,等于把自己最值钱的部分外包了。

“AI更适合用在‘结果重要、过程次要’的重复性任务上。”他说。

第二,给审核设定边界。

如果每天花在审核AI产出上的时间超过2小时,说明流程出了问题。可能是提示词不清晰,可能是上下文信息不足,可能是缺少自动化检查机制。总之,别把“无限制审核AI”当成常态。

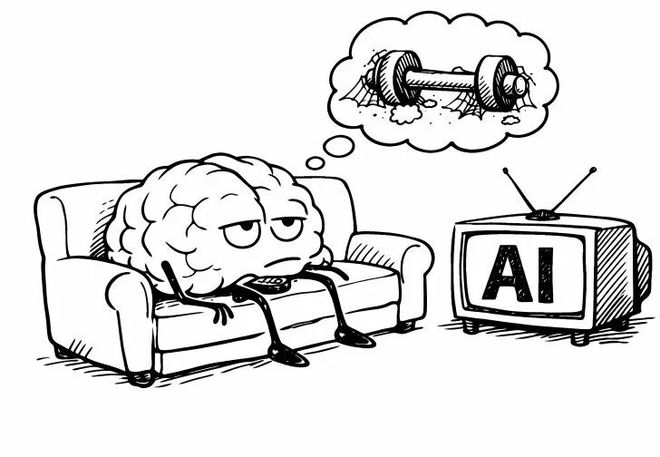

第三,保护你的深度工作时间。

AI会把你困在一个循环里:生成、审核、再生成、再审核。这个循环不断打断你的注意力。你需要刻意留出一段时间,完全不使用AI。

“最重要的工作,往往不需要依赖提示词,而是靠独立思考完成。”

第四,倒过来用AI。

现在很多人遇到问题,下意识就打开ChatGPT。还没开始思考,就让AI生成内容。

把顺序倒过来。先独立思考,明确目标,再判断是否需要AI。很多时候,一张白纸和二十分钟的独立思考,比任何提示词都管用。

“人们对AI的焦虑,本质是失去了掌控感。”Khare说,“当AI不停生成、不停给出建议,你就会觉得自己只是被动的执行者。”

“而一旦重新掌握‘是否用AI、何时用AI’的决定权,掌控感就会慢慢回归,焦虑感自然会下降。”

采访快结束时,我问他一个有点私人的问题:你自己还用AI吗?

他笑了。“用。但用得更少,想得更多。”

他说,AI最危险的,不是抢走你的工作,而是悄悄吃掉你的大脑。让你误以为生成就是思考,产出就是价值。让你习惯被动接受,而不是主动创造。

“别让AI替你思考。”他说,“让它做它最擅长的事——帮你处理那些你本来就不想做的事。然后把剩下的时间,留给真正重要的事。”

那些事,往往不需要AI。

需要的是你,一个完整的人,带着你的判断、你的经验、你那些AI永远无法复制的直觉和洞察。

窗外是硅谷的夜色。在这个被AI重新定义的年代,也许最大的奢侈,不是更快地生产,而是停下来,想一想:什么才是真正值得做的事。

然后,亲手去做它。